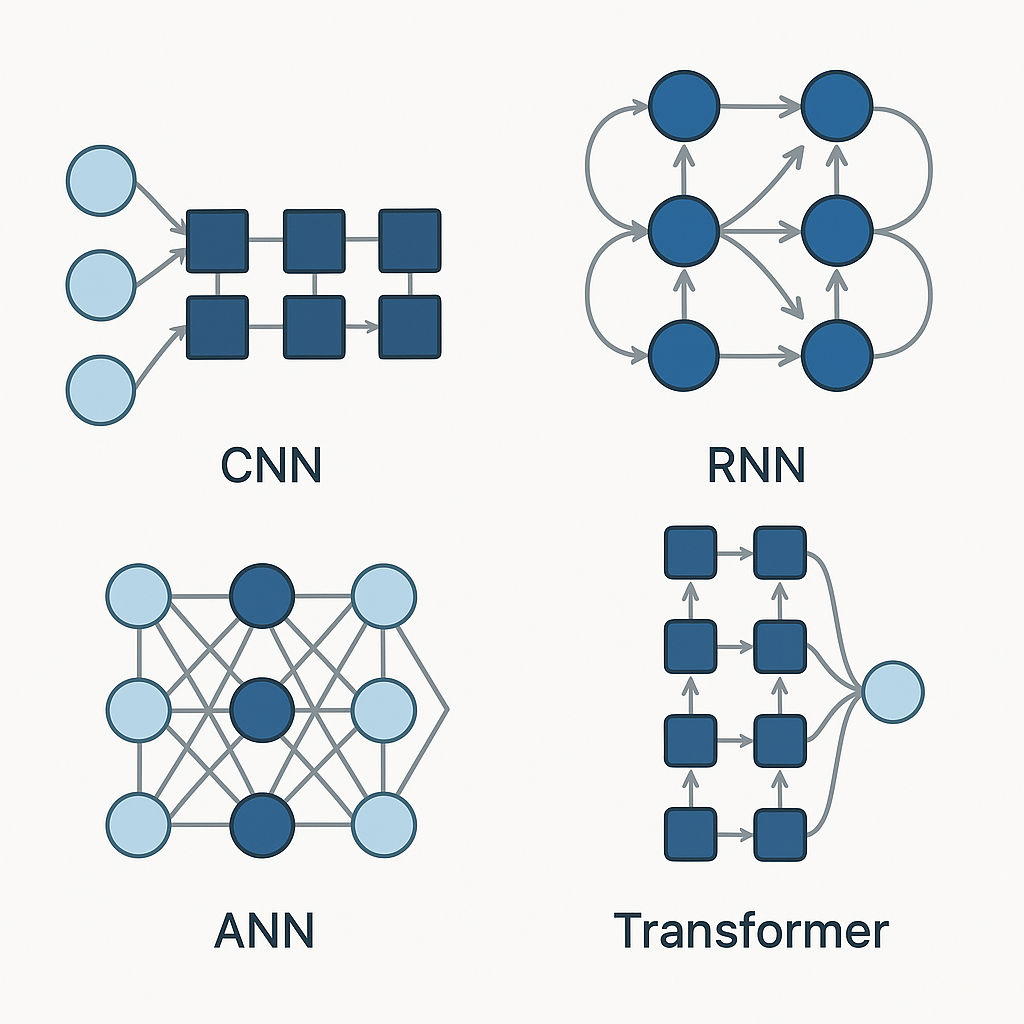

Las Redes Neuronales Convolucionales (CNNs) y las Redes Neuronales Recurrentes (RNNs) son arquitecturas fundamentales en Deep Learning, cada una optimizada para tipos diferentes de datos y tareas.

Redes Neuronales Convolucionales (CNN)

Las CNNs están diseñadas para procesar datos con estructura espacial, como imágenes. Usan operaciones de convolución para detectar patrones locales y jerárquicos.

Características Principales:

- Operaciones de convolución para extraer características

- Pooling para reducir dimensionalidad

- Jerarquía de patrones (bordes → formas → objetos)

- Parámetros compartidos (eficiente)

¿Cuándo Usar CNNs?

- Clasificación y detección de imágenes

- Reconocimiento facial

- Análisis de imágenes médicas

- Procesamiento de video (frame por frame)

Redes Neuronales Recurrentes (RNN)

Las RNNs están diseñadas para procesar secuencias temporales, manteniendo memoria de información anterior. Tienen conexiones que forman ciclos, permitiendo que la información persista.

Características Principales:

- Memoria de estados anteriores

- Procesamiento secuencial

- Capacidad de manejar secuencias de longitud variable

- Variantes como LSTM y GRU para mejor memoria de largo plazo

¿Cuándo Usar RNNs?

- Procesamiento de lenguaje natural

- Traducción automática

- Análisis de series temporales

- Generación de texto y habla

Comparación Rápida

CNNs: Excelentes para datos espaciales, procesamiento paralelo eficiente, pero no manejan bien secuencias largas.

RNNs: Ideales para datos secuenciales, capturan dependencias temporales, pero pueden ser lentas y tener problemas con vanishing gradients.

Arquitecturas Híbridas

En algunos casos, puedes combinar CNNs y RNNs:

- CNN para extraer características de imágenes + RNN para procesar secuencias de características

- Análisis de video: CNN procesa frames, RNN procesa secuencia temporal

- Image captioning: CNN extrae características visuales, RNN genera descripciones textuales

Alternativas Modernas

Hoy, arquitecturas más modernas están siendo preferidas:

- Transformers: Sustituyendo RNNs en muchas tareas de NLP

- Vision Transformers: Alternativa a las CNNs para imágenes

- Attention Mechanisms: Mejorando tanto CNNs como RNNs